Microsoft, un importante investitore di OpenAI, ha temporaneamente bloccato l’accesso dei suoi dipendenti a ChatGPT, il famoso strumento di intelligenza artificiale di OpenAI.

Il blocco è stato successivamente identificato come un risultato involontario dei test di sicurezza del sistema per i modelli linguistici di grandi dimensioni (LLM).

Microsoft blocca brevemente l’uso di ChatGPT

La mossa di Microsoft è stata resa nota giovedì, quando ai dipendenti del gigante del software è stato impedito di utilizzare ChatGPT. Microsoft ha annunciato internamente che:

“A causa di titoli di sicurezza e di dati, una serie di strumenti di intelligenza artificiale non sono più disponibili per i dipendenti”.

La restrizione non era esclusiva di ChatGPT, ma si estendeva anche ad altri servizi di AI esterni come Midjourney e Replika.

Nonostante la confusione iniziale, Microsoft ha ripristinato l’accesso a ChatGPT dopo aver identificato l’errore. Un portavoce ha poi chiarito che,

“Stavamo testando i sistemi di controllo degli endpoint per i LLM e li abbiamo inavvertitamente attivati per tutti i dipendenti”.

Microsoft ha incoraggiato i propri dipendenti e clienti a utilizzare servizi come Bing Chat Enterprise e ChatGPT Enterprise, sottolineando la loro superiore protezione della privacy e della sicurezza.

Il rapporto tra Microsoft e OpenAI è molto stretto. Microsoft ha sfruttato i servizi di OpenAI per migliorare il suo sistema operativo Windows e le applicazioni Office, con questi servizi che girano sull’infrastruttura cloud Azure di Microsoft.

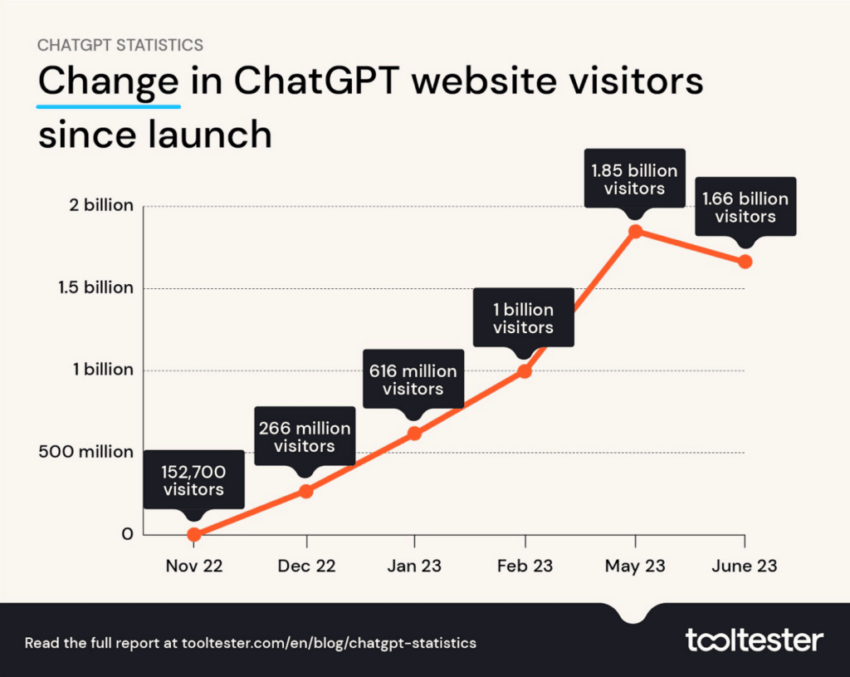

ChatGPT, un servizio con oltre 100 milioni di utenti, è famoso per le sue risposte simili a quelle umane ai messaggi di chat.

È stato addestrato su un’ampia gamma di dati Internet, il che ha portato alcune aziende a limitarne l’uso per evitare la condivisione di dati riservati. L’aggiornamento di Microsoft raccomanda l’uso del proprio strumento Bing Chat, che si basa anche sui modelli di intelligenza artificiale di OpenAI.

Pesare i rischi

Sulla scia di questi eventi, OpenAI, la società madre di ChatGPT, ha lanciato un team di preparazione. Questo team, guidato da Aleksander Madry, direttore del Center for Deployable Machine Learning del Massachusetts Institute of Technology, ha l’obiettivo di valutare e gestire i rischi posti dai modelli di intelligenza artificiale.

Questi rischi includono la persuasione personalizzata, la cybersicurezza e le minacce alla disinformazione.

Per saperne di più: 11 Migliori estensioni Chrome ChatGPT da controllare nel 2023

L’iniziativa di OpenAI giunge in un momento in cui il mondo è alle prese con i potenziali rischi dell’IA di frontiera, definita come:

“Modelli di IA generici altamente capaci, in grado di svolgere un’ampia varietà di compiti e di eguagliare o superare le capacità presenti nei modelli più avanzati di oggi”.

Mentre l’IA continua a evolversi e a plasmare il nostro mondo, aziende come Microsoft e OpenAI si stanno impegnando per garantirne un uso sicuro e responsabile, spingendo al contempo i confini di ciò che l’IA può raggiungere.

Le migliori piattaforme di criptovalute negli USA | Novembre 2023

Esclusione di responsabilità

In conformità alle linee guida del Trust Project, BeInCrypto si impegna a riportare notizie imparziali e trasparenti. Questo articolo mira a fornire informazioni accurate e tempestive. Tuttavia, si consiglia ai lettori di verificare i fatti in modo indipendente e di consultare un professionista prima di prendere qualsiasi decisione basata su questi contenuti.

Questo articolo è stato inizialmente compilato da un’intelligenza artificiale avanzata, progettata per estrarre, analizzare e organizzare le informazioni da un’ampia gamma di fonti. Opera senza credenze personali, emozioni o nonobiettivi, fornendo contenuti incentrati sui dati. Per garantire la pertinenza, l’accuratezza e l’aderenza agli standard editoriali di BeInCrypto, un redattore umano ha meticolosamente rivisto, modificato e approvato l’articolo per la pubblicazione.