Il cofondatore di Ethereum, Vitalik Buterin, ha discusso della sicurezza di Web3, sottolineando la sua crescente importanza in un mondo in cui i deepfake sono sempre più diffusi.

Il 9 febbraio Buterin ha riportato un recente rapporto su un’azienda che ha perso 25 milioni di dollari. Ciò è avvenuto quando un dipendente della finanza è stato ingannato da una convincente videochiamata deepfake.

La sicurezza di Web3 in evidenza nelle minacce di deepfake

I deepfake, ovvero i falsi audio o video generati dall’intelligenza artificiale, sono sempre più diffusi. Inoltre, rendono insicura l’autenticazione delle persone solo in base alla loro vista o al loro ascolto.

“Resta il fatto che a partire dal 2024, un flusso audio o persino video di una persona non sarà più un modo sicuro per autenticarne l’identità”, ha detto Buterin.

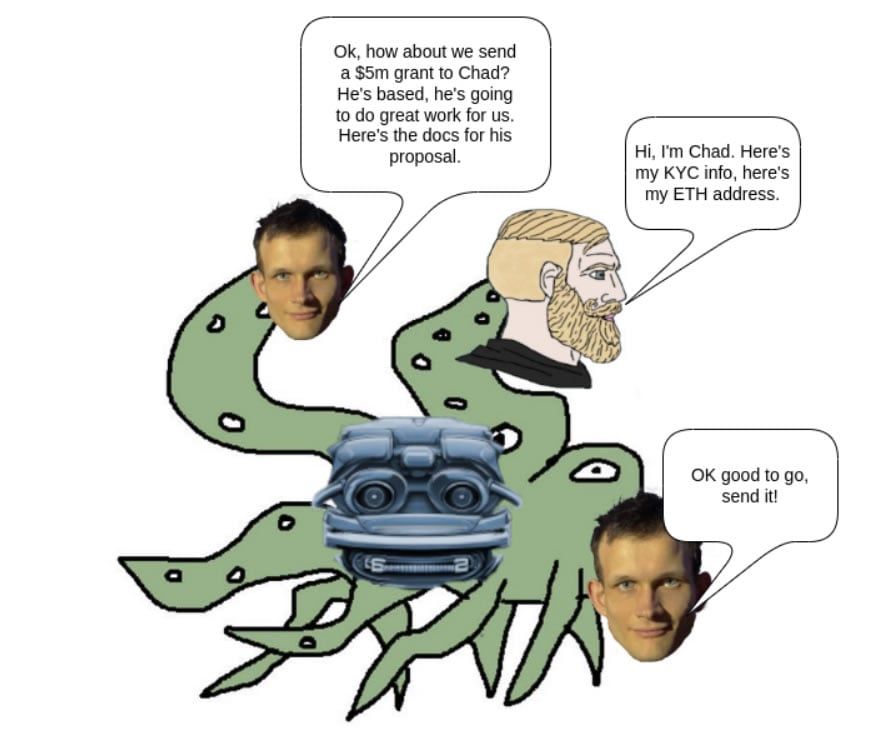

I metodi crittografici come la firma dei messaggi con chiavi private non sono sufficienti, ha osservato Buterin, spiegando che eludono lo scopo di far verificare l’identità a più firmatari. Tuttavia, porre “domande di sicurezza” personalizzate basate su esperienze condivise è un modo efficace per autenticare l’identità di qualcuno, ha aggiunto.

Le buone domande sono uniche, difficili da indovinare e sondano i “micro” dettagli che le persone ricordano.

“Le persone spesso smettono di impegnarsi nelle pratiche di sicurezza se queste sono noiose, quindi è salutare rendere le domande di sicurezza divertenti”, ha suggerito Buterin.

Le domande di sicurezza dovrebbero essere combinate con altre tecniche. Queste potrebbero includere parole in codice preconcordate, conferma multicanale delle informazioni, protezioni contro gli attacchi man-in-the-middle e ritardi o limiti alle azioni irreversibili.

Per saperne di più: 15 truffe di criptovalute più comuni da tenere d’occhio

Le domande di sicurezza da individuo a individuo differiscono da quelle da impresa a individuo, come le domande di sicurezza delle banche, e dovrebbero essere adattate alle persone coinvolte.

Buterin ha concluso che nessuna tecnica è perfetta. Tuttavia, le tecniche di stratificazione adattate alla situazione possono fornire una sicurezza Web3 efficace anche in un mondo in cui audio e video possono essere falsificati.

“In un mondo post deepfake, dobbiamo adattare le nostre strategie alla nuova realtà di ciò che è ora facile da falsificare e di ciò che rimane difficile da falsificare, ma finché lo facciamo, rimanere sicuri continua a essere possibile”, ha sottolineato Buterin.

Il 9 febbraio è stato riportato che voci, immagini e altri contenuti online manipolati di tipo deepfake hanno già avuto un impatto negativo sulle elezioni statunitensi di quest’anno. La Casa Bianca sta cercando di verificare tutte le sue comunicazioni e di prevenire varie forme di falsificazione, manipolazione e abuso dell’IA generativa, ha rivelato.

Il mese scorso, il World Economic Forum (WEF) ha rivelato che la disinformazione e i deepfake generati dall’IA rappresentano la più grande minaccia a breve termine per il mondo. Sempre a gennaio, il fondatore di MicroStrategy Michael Saylor ha avvisato di deepfake che lo ritraggono mentre cerca di truffare gli utenti con i loro Bitcoin.