Con l’evoluzione dell’intelligenza artificiale (AI), il suo potenziale per rafforzare le misure di sicurezza informatica è diventato un punto focale per le aziende di tutto il mondo.

Con l’allarmante intensificazione della velocità, della scala e della sofisticazione dei cyberattacchi, le aziende stanno integrando sempre più le tecnologie AI per superare i criminali informatici.

Come Microsoft e OpenAI intendono migliorare la cybersicurezza con l’IA

Microsoft ha collaborato con innovatori dell’IA come OpenAI per esplorare il ruolo dell’IA nella sicurezza informatica. In particolare, le aziende stanno esaminando il modo in cui gli attori malintenzionati fanno usoimproprio dell’IA e come questa possa essere utilizzata per la difesa. Inoltre, mirano a promuovere casi di utilizzo responsabile dell’IA, garantendo che i malintenzionati non la utilizzino per scopi dannosi.

L’iniziativa di Microsoft, in particolare con il suo Copilot for Security, esemplifica le misure proattive per potenziare la cybersecurity con strumenti basati sull’IA. Questi sforzi si allineano a mandati più ampi del settore, come l’ordine esecutivo della Casa Bianca sull’IA. L’ordine richiede standard di sicurezza e protezione rigorosi per i sistemi di IA che hanno un impatto sulla sicurezza nazionale e sul benessere pubblico.

“Come parte di questo impegno, abbiamo adottato misure per interrompere gli asset e gli account associati agli attori delle minacce, migliorare la protezione della tecnologia OpenAI LLM e degli utenti da attacchi o abusi, e modellare i meccanismi di protezione e sicurezza intorno ai nostri modelli”, ha spiegato Microsoft.

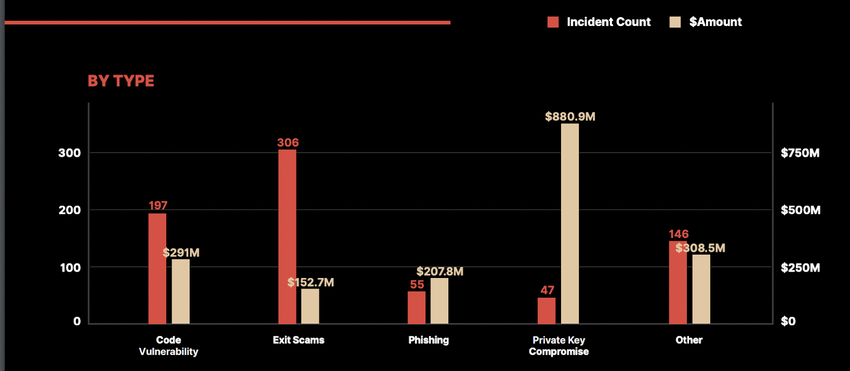

Nel 2023, il solo settore Web3 ha registrato una perdita impressionante di 1,8 miliardi di dollari in 751 incidenti di sicurezza. Questi incidenti spaziavano da exploit di codice e attacchi di phishing a schemi più complessi come la compromissione di chiavi private e le truffe di uscita, con questi ultimi che hanno rappresentato una parte significativa delle violazioni.

Per saperne di più: IA per le verifiche dei contratti intelligenti: Soluzione rapida o attività rischiosa?

Il tributo finanziario più grave è derivato dalla compromissione delle chiavi private, con una perdita colossale di 880,9 milioni di dollari per le aziende di criptovalute. In effetti, questa vulnerabilità mette in evidenza la necessità di solide misure di sicurezza per salvaguardare le informazioni sensibili.

In risposta a queste minacce in intensificazione, Microsoft ha progettato azioni politiche volte a interrompere l’uso dannoso dell’IA da parte di attori identificati, includendo le minacce avanzate persistenti (APT) degli Stati nazionali e i sindacati di criminali informatici. Questi principi comprendono l’identificazione e la neutralizzazione dell’uso dannoso dell’IA, la collaborazione con altri fornitori di servizi di IA per la condivisione delle informazioni sulle minacce e l’impegno alla trasparenza delle azioni intraprese contro gli attori delle minacce.

Per saperne di più: Sicurezza del progetto Crypto: Guida all’individuazione precoce delle minacce

La strategia di difesa congiunta di Microsoft e OpenAI offre uno sguardo al futuro della sicurezza informatica, in cui le capacità generative dell’IA vengono sfruttate per contrastare le attività dannose. Tracciando oltre 300 attori unici delle minacce, includendo attori di Stati nazionali e gruppi di ransomware, Microsoft Threat Intelligence svolge infatti un ruolo cruciale nell’identificare e facilitare le minacce facilitate dall’IA.