La società madre di ChatGPT, OpenAI, ha lanciato un team di preparazione per valutare i rischi posti dai modelli di intelligenza artificiale (AI).

Se da un lato i modelli di IA possono cambiare l’umanità in meglio, dall’altro pongono diversi rischi. Per questo motivo, i governi sono preoccupati per la gestione dei rischi di questa tecnologia.

Le funzioni del team di preparazione di OpenAI

Attraverso un post sul blog, OpenAI ha annunciato il lancio del team Preparedness. Il team lavorerà sotto la guida di Aleksander Madry, direttore del Massachusetts Institute of Technology’s Center for Deployable Machine Learning.

L’IA di frontiera presenta alcuni rischi, quali:

- persuasione personalizzata

- sicurezza informatica

- minacce chimiche, biologiche, radiologiche e nucleari (CBRN)

- Replicazione e adattamento autonomi (ARA)

Per saperne di più: 9 suggerimenti e consigli di ChatGPT per creare la descrizione del lavoro perfetta

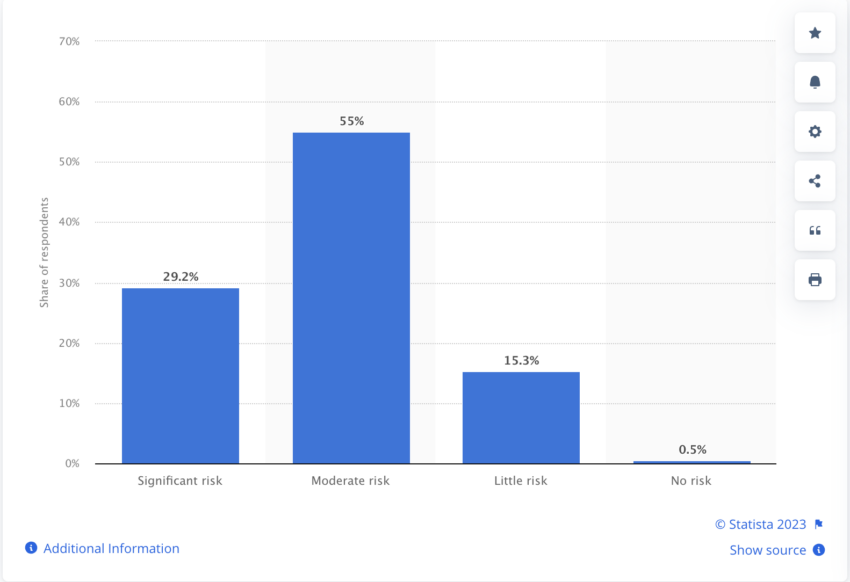

Inoltre, esiste il rischio di disinformazione e di propagazione di voci attraverso l’intelligenza artificiale. La schermata sottostante mostra la percentuale di professionisti che ritengono che l’intelligenza artificiale generativa (AI) rappresenti un rischio per la sicurezza del marchio e la disinformazione a livello mondiale.

L’amministrazione britannica definisce l’IA di frontiera come:

“Modelli di IA generica altamente capaci, in grado di svolgere un’ampia varietà di compiti e di eguagliare o superare le capacità presenti nei modelli più avanzati di oggi”.

Il team Preparedness di OpenAI si concentrerà sulla gestione dei rischi causati dai suddetti eventi catastrofici. La società madre di ChatGPT definisce questo sviluppo il suo contributo all’imminente summit globale sull’intelligenza artificiale nel Regno Unito.

Sempre a luglio, i portabandiera dell’IA come OpenAI, Meta, Google e altri si sono impegnati a garantire la sicurezza e la trasparenza nello sviluppo dell’IA alla Casa Bianca.

Ieri BeInCrypto ha riportato che il primo ministro britannico Rishi Sunak non vuole affrettare la regolamentazione dell’intelligenza artificiale. Tra gli altri fattori, è preoccupato che l’umanità possa perdere completamente il controllo dell’IA.

Leggi tutto: L’IA sostituirà gli esseri umani?

Avete qualcosa da dire sul team OpenAI Preparedness o su qualsiasi altra cosa? Scriveteci o partecipate alla discussione sul nostro canale Telegram. Potete trovarci anche su TikTok, Facebook o X (Twitter).

Per l’ultima analisi di BeInCrypto sulBitcoin (BTC), clicca qui.

Dichiarazione di non responsabilità

Tutte le informazioni contenute nel nostro sito web sono pubblicate in buona fede e solo a scopo informativo generale. Qualsiasi azione intrapresa dal lettore in base alle informazioni contenute nel nostro sito web è strettamente a suo rischio e pericolo.