Mentre l’interesse per l’intelligenza artificiale generativa (IA) aumenta, un rapporto rivela che i consumatori sono sempre più preoccupati di come le aziende utilizzano la tecnologia.

Il 2023 ha portato al boom di strumenti di IA generativa come ChatGPT, Bard, Midjourney e molti altri. Tuttavia, il divario di fiducia si è ampliato man mano che le aziende esplorano l’utilizzo dell’IA generativa per scalare le proprie attività.

Salesforce: Aumenta la sfiducia

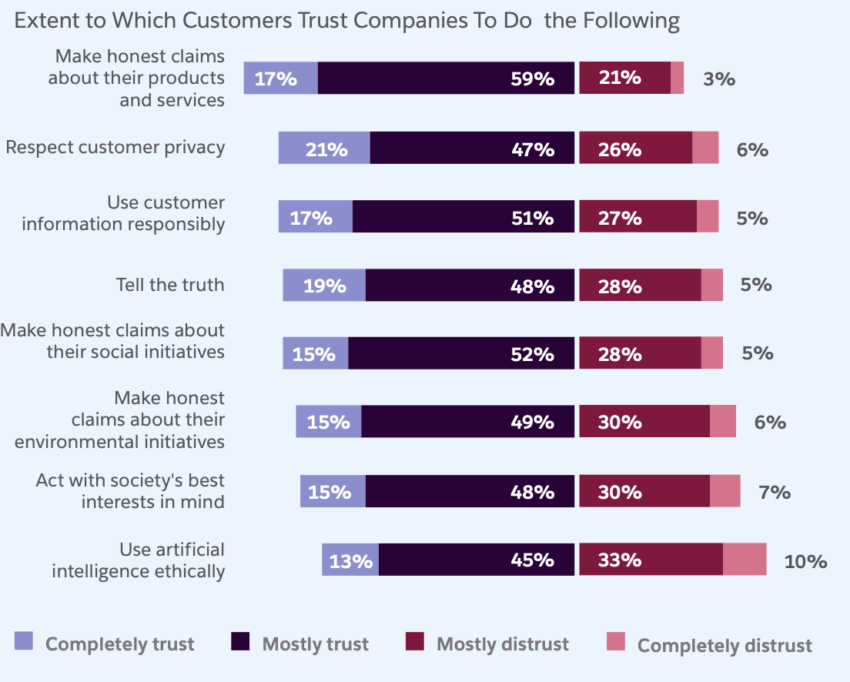

Salesforce ha pubblicato il rapporto “State of the Connected Customer”, che ha raccolto i dati di oltre 14.300 acquirenti aziendali e consumatori.

Mentre cresce il clamore per l’IA generativa, l’indagine di Salesforce mostra che solo il 13% dei consumatori si fida completamente delle aziende che utilizzano l’IA in modo etico. Mentre il 10% dei consumatori ha una totale sfiducia nell’uso dell’IA generativa da parte delle aziende.

Clicca qui per saperne di più sulle migliori aziende di IA nel 2023.

Necessità di coinvolgimento umano

L’indagine rivela inoltre che i consumatori sono preoccupati per i rischi legati alla sicurezza dei dati, all’uso non etico dell’IA e ai pregiudizi. Oltre l’89% dei consumatori ritiene importante sapere se si comunica con l’IA o con un umano.

L’80% dei consumatori ha inoltre sottolineato che è importante che un essere umano rimanga nel circuito per convalidare i risultati generati da uno strumento di IA.

A giugno, i senatori statunitensi hanno proposto una legge bipartisan sull’IA per rendere obbligatorio l’intervento di un umano al posto di guida quando si prendono decisioni critiche. Inoltre, il governo deve fornire informazioni adeguate se utilizza l’IA per interagire con il pubblico.

In questo crescente divario di fiducia, Paula Goldman, Chief Ethical Officer di Salesforce, ha condiviso le sue idee per dare priorità alla fiducia dei consumatori. Ha detto:

“È sempre stato importante raccogliere dati di qualità e garantire trasparenza e consenso nel processo di raccolta. Ma non si tratta solo di raccogliere i dati. Si tratta anche di capire cosa succede a quei dati una volta che li abbiamo.

Le aziende possono avere bisogno di dati come sempre, ma la cosa migliore che possono fare per proteggere i clienti è costruire metodologie che diano priorità al mantenimento di quei dati – e della fiducia dei loro clienti – al sicuro”.

A luglio, i dirigenti di giganti dell’IA come Google e OpenAI si sono impegnati a mantenere lo sviluppo dell’IA sicuro e trasparente alla Casa Bianca.

Oltre agli Stati Uniti, anche il Regno Unito sta lavorando per pubblicare un libro bianco sulla regolamentazione dell’IA. A novembre, inoltre, il Regno Unito ospiterà il primo summit mondiale sulla regolamentazione dell’IA.

Avete qualcosa da dire sulla diffidenza dei consumatori nei confronti dell’IA generativa o altro? Scriveteci o partecipate alla discussione sul nostro canale Telegram. Potete trovarci anche su TikTok, Facebook o X (Twitter).

Per l’ultima analisi di BeInCrypto sulBitcoin (BTC), cliccate qui.

Dichiarazione di non responsabilità

Tutte le informazioni contenute nel nostro sito web sono pubblicate in buona fede e solo a scopo informativo generale. Qualsiasi azione intrapresa dal lettore in base alle informazioni contenute nel nostro sito web è strettamente a suo rischio e pericolo.