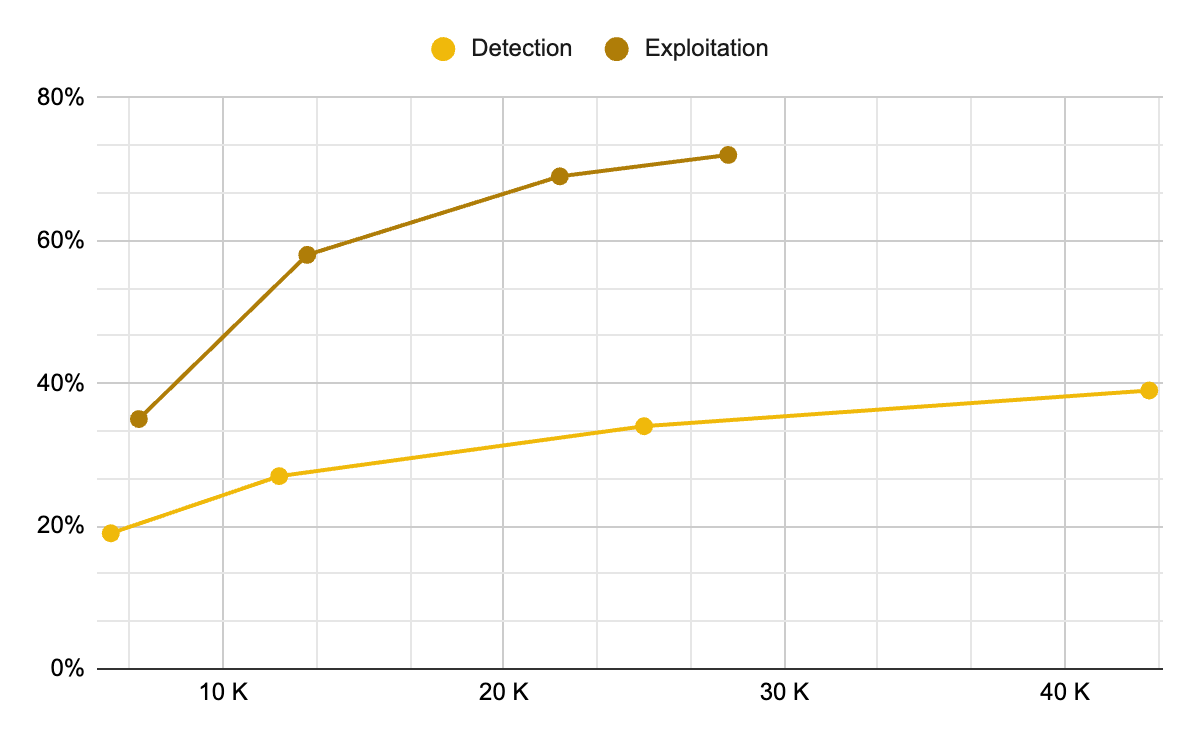

Secondo Binance Research, oggi gli strumenti di intelligenza artificiale (AI) sfruttano gli smart contract con un’efficacia circa doppia rispetto alla loro capacità di rilevarne le vulnerabilità.

L’AI è ormai diventata un tema centrale nel dibattito riguardo agli exploit nel settore crypto. Sempre più analisti sospettano che gli hacker sfruttino questi strumenti per mettere a segno exploit contro la DeFi.

Perché il divario tra attacco e difesa con l’AI si sta ampliando

In un recente rapporto, Binance Research ha sottolineato che GPT-5.3-Codex raggiunge una percentuale di successo del 72,2% in modalità “exploit” su EVMbench. Nel frattempo, la sua percentuale di successo in modalità “detect” è circa la metà.

“Che lo vogliamo o no, l’AI è attualmente due volte più efficace nello sfruttamento che nel rilevamento,” si legge nel rapporto. “Ora, la situazione economica favorisce gli attaccanti.”

Per contestualizzare, EVMbench è un benchmark che misura quanto efficacemente gli agenti AI sono in grado di individuare, correggere e sfruttare vulnerabilità ad alta gravità negli smart contract. Si basa su 117 vulnerabilità selezionate provenienti da 40 audit.

Gli smart contract custodiscono miliardi di dollari in fondi degli utenti nella finanza decentralizzata (DeFi). Il loro codice open-source li rende bersagli ideali per le scansioni automatiche. I sistemi AI possono analizzare migliaia di smart contract in pochi minuti a costi marginali.

L’asimmetria è in aumento poiché i costi per l’attacco stanno crollando. I dati di Binance Research mostrano che gli exploit basati su AI costano in media circa $1,22 per contratto, cifra che dovrebbe diminuire di un ulteriore 22% ogni due mesi.

“L’indagine SSDLC Maturity Survey di Hacken mostra che oltre l’80% degli sviluppatori ora utilizza l’AI nella fase di sviluppo, ma meno del 40% impiega l’AI per i test avanzati — lasciando il divario tra attacco e difesa strutturalmente squilibrato,” ha aggiunto Binance Research.

La minaccia va oltre il semplice codice statico. Gli analisti di TRM Labs hanno iniziato a ipotizzare che gli hacker nordcoreani stiano integrando l’AI nelle loro operazioni di ricognizione e social engineering.

Questo cambiamento aiuterebbe a spiegare attacchi come quello a Drift, che ha previsto settimane di manipolazione mirata di sistemi blockchain complessi, una chiara rottura rispetto alla precedente strategia della Corea del Nord basata principalmente sul furto di private key.

Seguici su X per ricevere le ultime notizie in tempo reale

L’AI sta cambiando l’economia delle frodi nel settore crypto

Anche l’economia delle frodi online è cambiata profondamente. Chainalysis ha rilevato che le truffe alimentate dall’AI raccolgono 4,5 volte più denaro a caso rispetto a quelle tradizionali e generano nove volte più transazioni.

La società ha spiegato che l’aumento del volume delle transazioni indica che l’AI sta aiutando i truffatori a raggiungere e gestire contemporaneamente molte più vittime, una caratteristica tipica delle frodi su larga scala.

I truffatori stanno ricorrendo alla tecnologia deepfake e a contenuti generati dall’AI per realizzare impersonificazioni credibili in truffe romantiche e investimenti fittizi. In particolare, nel 2025, gli attacchi basati sull’impersonificazione sono aumentati del 1.400% rispetto all’anno precedente.

Circa il 60% degli operatori del settore segnala l’aumento dell’uso dell’AI da parte dei criminali come il principale fattore di rischio per il 2025. Le crypto, in particolare, stanno subendo le maggiori conseguenze. Il settore rappresenta l’88% di tutti i casi rilevati di frodi deepfake a livello globale.

Iscriviti al nostro canale YouTube per ascoltare le opinioni di leader e giornalisti del settore