Anthropic ha fatto causa al governo degli Stati Uniti dopo che il Pentagono ha etichettato l’azienda come un “rischio per la catena di approvvigionamento”, una decisione che potrebbe ridefinire il modo in cui i fornitori di intelligenza artificiale lavorano con l’esercito. La causa contesta questa decisione e solleva interrogativi su come gli appaltatori della difesa scelgano i sistemi di intelligenza artificiale.

I mercati ora osservano se la controversia potrebbe avere ripercussioni sulle aziende legate all’infrastruttura di intelligenza artificiale militare, tra cui software house come Palantir Technologies e appaltatori della difesa come Lockheed Martin.

Etichetta del Pentagono scatena battaglia legale

La disputa è iniziata all’inizio di questo mese, quando il Dipartimento della Difesa degli Stati Uniti ha formalmente classificato Anthropic come un rischio per la catena di approvvigionamento.

Questa designazione impedisce di fatto agli appaltatori della difesa di utilizzare i sistemi di intelligenza artificiale di Anthropic in determinati programmi militari.

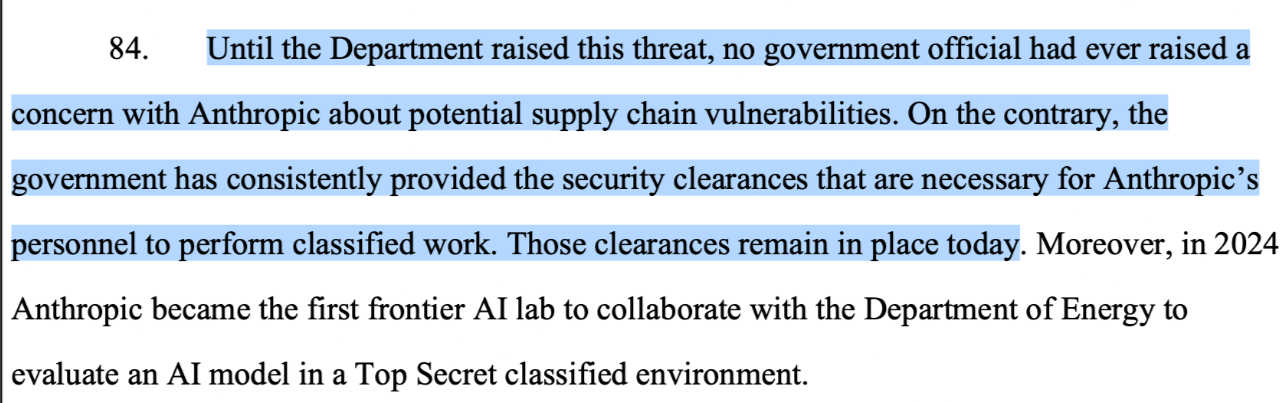

I funzionari del Pentagono hanno sostenuto che il provvedimento tutela la sicurezza nazionale e assicura che gli strumenti di intelligenza artificiale usati nei sistemi di difesa rispettino rigorosi standard di catena di approvvigionamento.

La decisione ha avuto un impatto immediato sugli appaltatori che integrano modelli di intelligenza artificiale commerciali nei software e nei sistemi di analisi militari.

Anthropic ha respinto con fermezza questa classificazione. L’azienda sostiene che la designazione manca di trasparenza e possa escludere ingiustamente un importante fornitore di intelligenza artificiale dai lavori governativi.

Lunedì, Anthropic ha presentato una causa per contestare la decisione del governo.

Secondo i documenti presentati in tribunale, l’azienda sostiene che il Pentagono abbia agito senza una motivazione chiara e che questa etichettatura danneggi la sua capacità di competere per i contratti federali.

La causa chiede al tribunale di bloccare la designazione e obbligare il governo a spiegare in dettaglio le ragioni di sicurezza nazionale alla base di questa decisione.

Rischi per i partner tecnologici della difesa USA

Lo scontro legale potrebbe generare incertezza per le aziende che si basano su modelli di intelligenza artificiale esterni nei sistemi software militari.

Uno dei nomi più osservati è Palantir Technologies, che realizza piattaforme di analisi usate dall’esercito e dalle agenzie d’intelligence degli Stati Uniti.

Se i modelli di Anthropic venissero limitati nei programmi di difesa, Palantir e altri appaltatori simili potrebbero dover passare a fornitori di AI alternativi.

Tali cambiamenti possono rallentare i tempi di implementazione e richiedere adeguamenti tecnici. Tuttavia, la maggior parte degli analisti si aspetta che i fornitori di software sostituiranno i modelli piuttosto che perdere i contratti con il governo.

I grandi produttori della difesa affrontano un rischio minore.

Lockheed Martin, il principale appaltatore della difesa negli Stati Uniti, ha dichiarato di non fare affidamento su un solo fornitore di AI. L’azienda ha fatto sapere che la decisione del Pentagono avrà probabilmente un impatto minimo sui suoi programmi.

Questo riflette una tendenza più ampia nella tecnologia per la difesa: i principali appaltatori integrano di solito diversi fornitori, in modo da non dipendere da un solo provider di software.

Opportunità per i fornitori di intelligenza artificiale rivali

Sebbene la causa generi incertezza per Anthropic, potrebbe favorire aziende concorrenti nel settore dell’intelligenza artificiale.

Se il Pentagono manterrà le restrizioni, gli appaltatori della difesa potrebbero orientarsi verso altri fornitori di modelli, come OpenAI o piattaforme cloud legate a Microsoft e Amazon.

Queste aziende già forniscono infrastrutture e servizi di intelligenza artificiale utilizzati da agenzie governative. Un cambiamento nei processi di approvvigionamento potrebbe espandere il loro ruolo nei sistemi di AI militare.

Tuttavia, ora il risultato dipende dai tribunali. Se Anthropic dovesse vincere la causa, il Pentagono potrebbe essere costretto a rivedere o limitare la designazione di rischio per la catena di approvvigionamento.

Per gli investitori e i contractor della difesa, la disputa mette in evidenza una questione più ampia.

Man mano che l’intelligenza artificiale diventa centrale nei sistemi militari, la capacità del governo di approvare o limitare i fornitori di soluzioni AI potrebbe influenzare sia il settore tecnologico sia le filiere dell’industria della difesa.